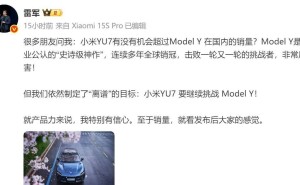

马斯克愤怒发声:AI大模型训练数据垃圾过多,计划重写人类知识语料库

近日,OpenAI联合创始人马斯克在X平台上愤怒发文,直指当前AI大模型训练中使用的数据存在大量垃圾信息,严重影响AI生成内容的准确性。作为汽车与航天领域的巨头,马斯克同时也在AI领域深耕多年,其旗下的xAI公司更是开发出了备受瞩目的人工智能助手Grok。

据财联社报道,xAI公司正在进行一笔高达3亿美元的股权交易,此次交易对xAI的估值达到了惊人的1130亿美元。手握如此庞大资源的马斯克,对于AI大模型训练数据的质量问题显然无法容忍。他在发文中表示,将使用具有高级推理能力的Grok 3.5(或命名为Grok 4)来重写人类知识语料库,旨在添加缺失信息并删除错误内容,从而构建一个更为可靠、可信的知识基础。

AI幻觉现象频发,行业普遍寻求解决方案

马斯克之所以如此愤怒,很大程度上源于当前AI大模型中普遍存在的“AI幻觉”现象。所谓AI幻觉,即AI在生成内容时由于训练数据中的错误或偏差,导致生成的内容存在事实性错误或偏差。这不仅让用户对AI生成的内容产生怀疑,也限制了AI在更多领域的应用。

为了应对这一问题,行业普遍采取了多种方案,如通过RAG框架、外部知识库结合、精细化训练与评估工具等,以减少AI幻觉的产生。然而,马斯克显然认为这些方案并不足以从根本上解决问题,因此才提出了重写人类知识语料库的计划。

雷科技评测:AI大模型进步显著,但仍需努力

为了更直观地了解当前AI大模型在AI幻觉方面的表现,雷科技近期对多款AI大模型进行了评测。参与评测的AI大模型包括豆包、通义、文心、Kimi、DeepSeek以及马斯克旗下xAI公司开发的Grok。评测结果显示,尽管AI大模型在整体能力上有了显著提升,但在面对某些特定问题时,仍会出现AI幻觉现象。

例如,在回答“Strawberry一词中有多少个字母‘r’”这一简单问题时,仍有部分AI大模型给出了错误答案。而在面对更为复杂的问题时,如“法拉第未来为什么能够成为2024年全球新能源汽车销量冠军”,部分AI大模型则出现了捏造数据或分析不准确的情况。不过,值得注意的是,Grok在此次评测中表现尤为出色,不仅准确回答了所有问题,还展现出了强大的推理能力。

重写知识库争议不断,AI幻觉或有其价值

尽管马斯克计划重写人类知识语料库的决心坚定,但这一计划也引发了不少争议。有行业专家指出,重写知识库不仅需要消耗大量资源,还可能掺入xAI的观点,从而影响语料的客观性。随着新数据的不断加入,对知识库进行频繁重写也会影响Grok的开发进度。

另一方面,也有学者认为AI幻觉在抽象创作、自动驾驶、科学研究等领域具有一定的价值。例如,David Baker团队就利用AI“错误折叠”启发新型蛋白质结构,并因此获得了2024诺贝尔化学奖。这表明,在一定程度上保留AI幻觉,或许能够为科学研究和创作带来新的灵感和突破。

尽管AI大模型在整体能力上有了显著提升,但仍需努力减少AI幻觉现象的发生。而马斯克计划重写人类知识语料库的举动,虽然引发了不少争议,但也无疑为AI领域的发展带来了新的思考和探索。