近期,谷歌首席执行官桑达尔·皮查伊在一档知名播客节目中,对人工智能的发展现状提出了新颖的观点,引发了业界的广泛关注。

在这档由雷克斯·弗莱德曼主持的播客中,皮查伊将当前的人工智能发展阶段形象地称为“AJI”,即锯齿人工智能。他提到,这一术语或许源自前OpenAI联合创始人安德烈·卡帕西,后者曾在社交媒体上发文详细阐述过这一概念。

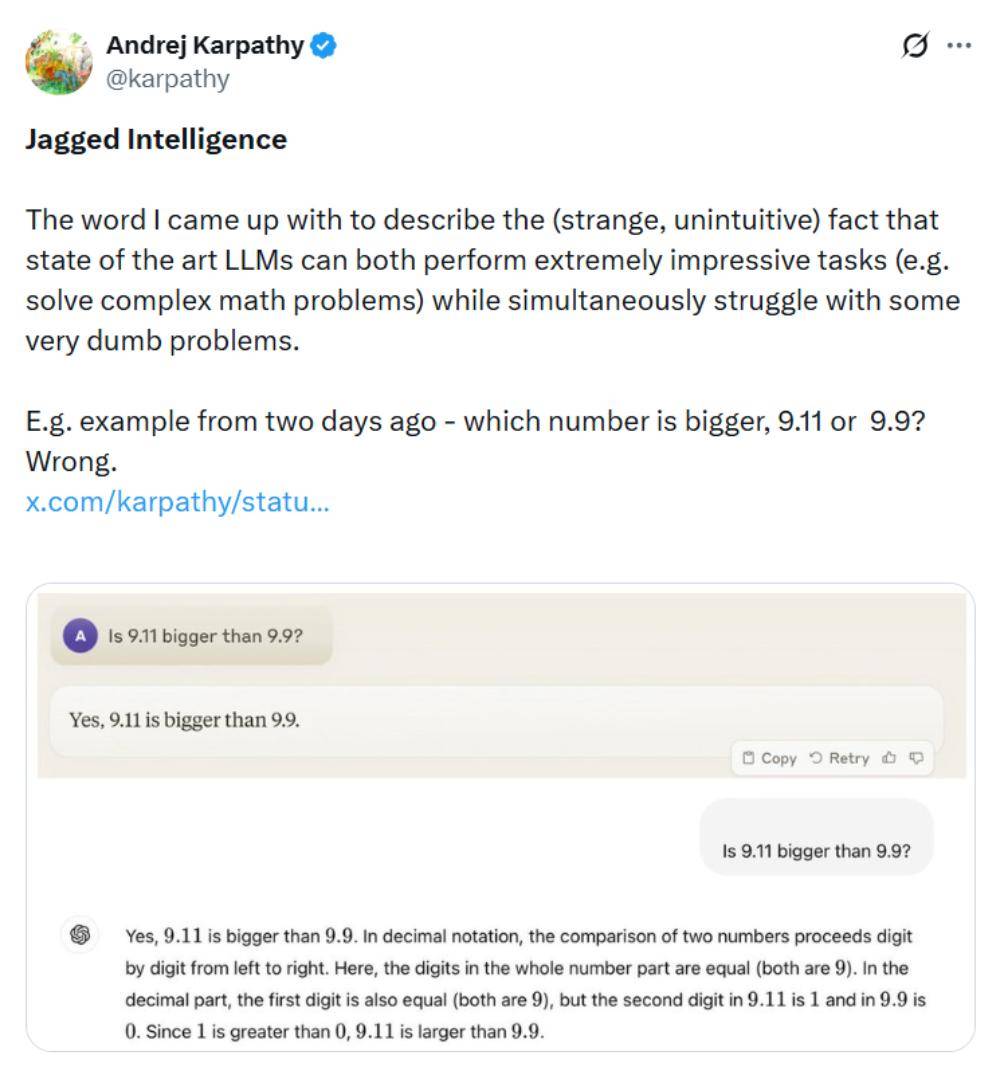

卡帕西在推文中指出,AJI描述了一种反直觉的现象:最先进的大语言模型在解决复杂数学问题的同时,却会犯下诸如“9.9大于9.11”这样的低级错误。他列举了大语言模型在井字棋游戏中做出荒谬决策、计数障碍等案例,以此来说明AI发展的锯齿状轨迹。

皮查伊对卡帕西的这一观点表示高度认同。他提到,AI的发展并非线性,而是充满了起伏和波折。就像人们会惊叹于AI的某些能力,但转眼间又会发现它犯下了数字错误或数不清“strawberry”中的字母R这样的基础问题。皮查伊认为,这正是AJI阶段的典型特征:在突飞猛进中夹杂着明显缺陷,但整体仍在快速进化。

在谈到AI的未来发展趋势时,皮查伊表示,早在2010年谷歌DeepMind成立时,其团队就曾预测实现通用人工智能(AGI)需要20年。然而,现在看来,这个时间可能会更长。他预计,到2030年,世界将需要建立AI内容标识系统来“区分现实”。皮查伊强调,虽然定义本身并不重要,但届时AI将在多个维度上取得突破性进展。

在去年的联合国“未来峰会”上,皮查伊曾详细阐述了AI将带来的四大益处:改善母语知识获取、加速科学发现、缓解气候灾难以及促进经济进步。然而,要实现这些目标,AI首先需要克服其基础逻辑校验和常识性判断上的缺陷。

皮查伊引用的“锯齿比喻”不仅形象地描绘了当前AI发展的局势,也提醒了业界:在追求AI技术迭代的过程中,不应仅以“攻克难题”作为单一评价维度。相反,更应该关注AI在基础逻辑校验、常识性判断等底层能力上的表现。因为,一个在专业领域表现卓越却频繁输出常识性错误的模型,不仅可能误导用户决策,更会侵蚀用户信任。

对于广大普通用户而言,他们更关心的是AI能否精准识别“1.11与1.8的数值大小”、“strawberry里有几个字母R”等基础问题。这些看似简单的问题,实际上却是衡量AI底层能力的重要指标。