新年伊始,AI技术领域迎来一项重要突破——DeepSeek团队悄然发布一篇论文,提出名为mHC的新型架构,旨在破解大规模模型训练中的稳定性难题,同时维持性能优势。这一成果虽未大张旗鼓宣传,却在科研圈引发广泛关注。

大模型训练长期面临“效率与稳定”的矛盾。早期模型采用单通道残差连接设计,类似工厂中的单条传送带,通过“恒等映射”确保信息完整传递,训练过程稳定可靠。但随着模型规模指数级增长,单通道逐渐成为瓶颈——信息拥堵、传输效率低下,直接制约了模型性能的提升。

为突破这一限制,行业曾尝试“超连接”方案,通过构建多通道传输体系提升效率。字节跳动等团队的研究表明,多通道设计虽能显著提高信息吞吐量,却因缺乏统一调度机制,导致信息在传输过程中出现“能量失衡”:部分通道信号被过度放大,另一些则被压制,最终引发梯度爆炸,模型训练中途崩溃。某头部企业曾耗资数千万训练千亿级模型,仅完成一万余步便因损失值飙升被迫终止,前期投入化为泡影。

DeepSeek的mHC架构正是为解决这一痛点而生。研究团队并未否定多通道的思路,而是创新性地引入智能调度系统。该系统基于Sinkhorn-Knopp算法,将连接矩阵约束在“双拟随机矩阵”的数学框架内——矩阵的行与列之和均为1,且所有元素非负。这一设计确保了信息传播过程中的“能量守恒”,从根本上避免了信号失真。架构还对输入输出映射施加非负约束,防止正负系数相互抵消导致有效信息丢失。

为降低技术落地成本,研究团队同步优化了训练基础设施。通过融合多个计算步骤为单一算子,减少内存读写次数;采用“重计算”策略,在反向传播阶段重新生成中间数据,大幅降低内存占用。实验数据显示,在扩展倍率为4的条件下,训练时间仅微增,但稳定性得到质的提升。

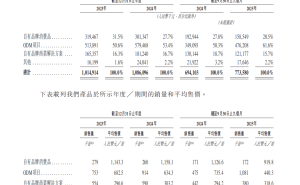

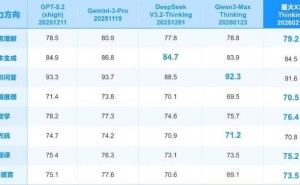

实证研究验证了mHC的实效性。团队以270亿参数模型为测试对象,发现其训练损失值显著低于传统基线模型,下游任务表现全面超越,尤其在推理类任务中较超连接方案提升数个百分点。规模扩展实验进一步证明,从30亿到270亿参数的模型训练中,mHC的性能优势始终稳定,未因数据量增加而衰减,显示出极强的泛化能力。

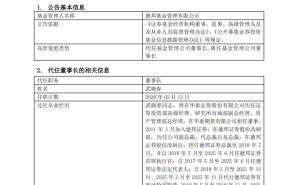

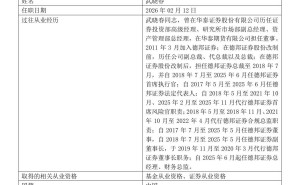

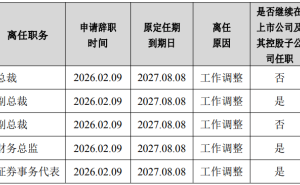

这项研究的价值不仅限于技术层面。长期以来,高昂的训练成本与稳定性风险令许多中小企业对大规模模型望而却步。mHC架构通过精细化设计平衡性能、稳定性与成本,为行业提供了可复制的解决方案,有望降低技术门槛,推动AI应用的普及。论文作者阵容中,创始人梁文锋的参与更凸显了DeepSeek对该研究的战略重视。