在上海,一场聚焦于金融AI推理应用落地与发展的论坛近日成功举办。此次论坛吸引了众多行业精英,其中包括中国银联执行副总裁涂晓军与华为数字金融军团CEO曹冲,两位嘉宾在会上发表了精彩致辞。

会上,华为带来了一项技术创新的重磅消息。华为公司副总裁、数据存储产品线总裁周跃峰博士正式发布了AI推理领域的创新技术——UCM推理记忆数据管理器。这一技术旨在提升AI推理的体验与性价比,推动AI技术在商业领域的正向循环。

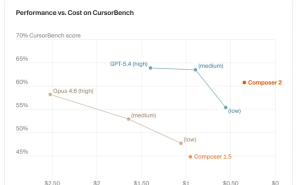

据周跃峰介绍,随着人工智能进入发展的关键阶段,AI推理已成为行业关注的焦点。推理效率与成本,成为衡量AI模型价值的重要标准。在AI时代,推理的效率与体验往往以Token数为衡量单位,这意味着“Token经济”的时代已经到来。然而,如何在提升推理效率的同时控制成本,成为行业面临的一大挑战。

为了应对这一挑战,华为推出了UCM推理记忆数据管理器。该技术由三大核心组件构成:推理引擎插件(Connector)、功能库(Accelerator)以及高性能存取适配器(Adapter)。通过这三层协同,UCM能够实现AI推理在体验与成本上的双重优化。

UCM在推理体验上的提升尤为显著。借助层级化自适应的全局前缀缓存技术,系统能够直接调用KV缓存数据,避免重复计算,从而将首Token时延最大降低90%。同时,UCM还能将超长序列缓存分层卸载至外置专业存储,通过算法创新实现推理上下文窗口的10倍级扩展,满足长文本处理的需求。

在降低成本方面,UCM同样表现出色。该技术具备智能分级缓存能力,能够根据记忆热度在HBM、DRAM、SSD等存储介质中实现按需流动。UCM还融合了多种稀疏注意力算法,实现存算深度协同,使长序列场景下的TPS提升2-22倍,显著降低每Token推理成本。

在中国银联与华为的联合创新技术试点中,UCM的技术价值得到了充分验证。在中国银联的“客户之声”业务场景下,借助UCM技术及工程化手段,大模型推理速度提升了125倍,仅需10秒即可精准识别客户高频问题,显著提升了服务质量。

论坛现场,华为还公布了UCM的开源计划。通过开放统一的南北向接口,UCM可适配多类型推理引擎框架、算力及存储系统。今年9月,UCM将正式开源,并逐步贡献给业界主流推理引擎社区,与全行业共同推动AI推理生态的繁荣发展。