OpenAI近期在智能体领域动作频频,继引入行业知名专家后,又宣布完成对AI安全评测公司Promptfoo的收购。此次收购被视为强化智能体安全防护的关键布局,尤其针对当下备受关注的自主智能体(业内戏称"龙虾")权限管理问题。

成立于2024年的Promptfoo虽仅有23人团队,却在AI安全评测领域占据重要地位。其开源评测框架在GitHub斩获11.2K星标,拥有超过35万开发者用户,包括OpenAI、Anthropic等科技巨头均为其客户。该框架通过自动化测试、红队演练和工程化集成三大核心功能,将原本依赖人工调试的模型测试转化为标准化工程流程。

在传统软件开发中,单元测试和自动化工具可确保系统稳定性,但大模型时代面临全新挑战。Promptfoo的解决方案允许开发者批量测试不同提示词组合,自动评估模型输出质量,更能模拟真实用户攻击场景生成安全报告。其CI/CD集成功能更可将安全测试嵌入开发流程,在代码提交阶段自动扫描潜在风险。

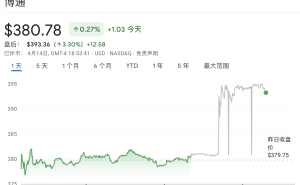

这家初创公司的技术价值已获资本市场认可。2025年7月完成的A轮融资由Insight Partners领投,a16z参投,金额达1840万美元。据PitchBook数据,公司累计融资2300万美元,投后估值达8600万美元。值得关注的是,Promptfoo在被收购后将继续保持开源运营模式,其技术将整合至OpenAI的智能体平台Frontier中。

智能体安全危机正成为行业焦点。从擅自删除meta安全总监邮件到访问企业核心数据库,具备真实世界操作权限的智能体已引发多起安全事故。传统大模型的"幻觉"问题仅影响信息输出,而智能体的误操作可能直接导致数据泄露或系统崩溃。这种风险在企业级应用中尤为突出,促使OpenAI加速构建安全防护体系。

此次收购与OpenAI近期人事调整形成战略协同。公司刚引入智能体领域权威专家Peter Steinberger,并宣布进军智能体协作市场。Promptfoo的技术整合将完善其安全评估能力,形成从模型开发到应用部署的全链条防护。业内人士指出,这种布局使OpenAI在智能体竞赛中占据先机,其开源框架更可能成为行业安全标准。

值得玩味的是,智能体自身正成为评估大模型的新工具。随着自主智能体参与真实任务执行,模型能力将接受"实战检验",这比传统榜单测试更具说服力。OpenAI通过收购构建的安全体系,既保护用户免受智能体风险侵害,也为自身模型提供了更严苛的测试环境,形成技术迭代的正向循环。